AI ACT: TORNA L’APPROCCIO RISK BASED

Partiamo dall’origine…

L’AI Act, Atto dell’UE sull’intelligenza artificiale (prima regolamentazione al mondo), mira a promuovere i sistemi di Intelligenza Artificiale, assicurando al contempo che questa innovazione tecnologica sia conforme ai valori, ai diritti fondamentali e ai principi dell’Unione.

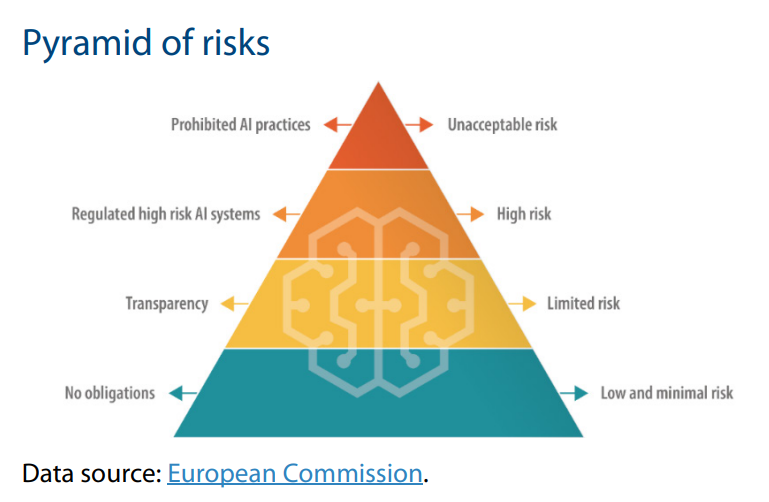

A tal fine, la norma propone un approccio basato sul rischio, caratteristica che la accomuna al GDPR, in cui sono le stesse organizzazioni a dover dimostrare la propria conformità, in ottemperanza al principio di responsabilizzazione.

I sistemi di IA e le relative applicazioni, vengono quindi analizzate e classificate in base al rischio generato per gli utenti. I diversi livelli di rischio comportano dunque una maggiore o minore regolamentazione.

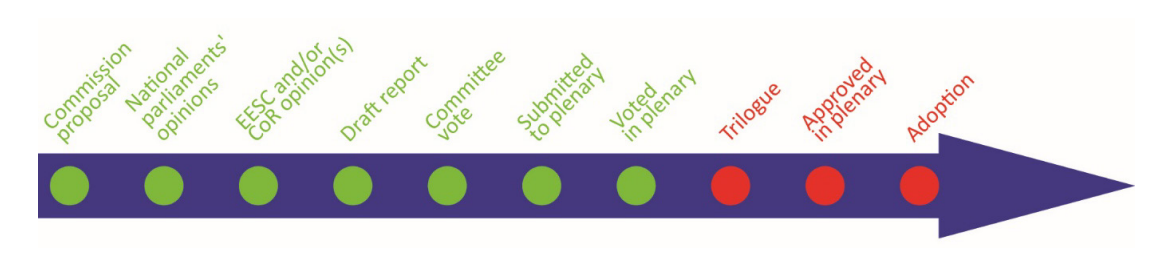

Il 9 dicembre 2023, dopo mesi di negoziati il Consiglio e il Parlamento europeo hanno raggiunto un accordo politico, seppur provvisorio.

Le principali novità nell’IA Act

Rispetto alla proposta originaria della Commissione, la bozza di accordo introduce:

- disposizioni specifiche applicabili ai sistemi di IA ad alto impatto e ad alto rischio;

- obbligo di stesura della valutazione dell’impatto sui diritti fondamentali, nonché obblighi di trasparenza da attuare prima dell’immissione sul mercato;

- controlli puntuali sui sistemi di intelligenza artificiale, a partire da GPT;

- l’obbligo di apporre un “watermark”, ovvero una apposita filigrana, chiaramente riconoscibile, che contrassegna i contenuti generati da IA;

- l’istituzione di un “Ufficio IA” all’interno della Commissione Europea con il compito di supervisionare i modelli AI più avanzati, contribuire alla promozione di standard e pratiche di test e applicare le regole comuni in tutti gli Stati membri;

- un’estensione dei divieti, con alcune deroghe in relazione ai sistemi utilizzati dalle forze dell’ordine.

Campo di applicazione

L’accordo provvisorio chiarisce che le disposizioni del Regolamento NON si applicano:

- ad aree al di fuori del campo di applicazione del diritto dell’UE;

- ai sistemi utilizzati esclusivamente per scopi militari o di difesa;

- ai sistemi di IA utilizzati al solo scopo di ricerca e innovazione;

- a coloro che utilizzano l’IA per motivi non professionali.

Cosa non si potrà fare con l’AI?

Come anticipato, la proposta di Regolamento impone dei divieti puntuali, per evitare contrasti con i diritti fondamentali delle persone riconosciuti dall’UE.

Di seguito i principali:

- divieto relativo all’utilizzo dell’IA per l’analisi di dati biometrici e di dati particolari / sensibili;

- divieto di effettuare scraping, in quanto raccolta non mirata di immagini facciali da internet o da filmati di telecamere a circuito chiuso per creare database (la raccolta di immagini dalle videocamere di sicurezza pubbliche sarà possibile solo da parte delle Autorità in caso di crimini gravi);

- divieto di uso dell’IA per riconoscere le emozioni in luoghi di lavoro e istituzioni educative;

- divieto di utilizzare tecniche di social scoring, ovvero di analizzare mediante IA il comportamento delle persone al fine di assegnare un punteggio alle stesse;

- divieto di manipolazione cognitivo-comportamentale;

- divieto di uso di IA che sfruttano le vulnerabilità delle persone, come l’età, disabilità, situazione sociale o economica;

- divieto di polizia predittiva (utilizzo di sistemi di IA da parte delle forze dell’ordine per l’elaborazione di previsioni statistiche di luoghi, modalità, tempi, e/o autori di un possibile crimine futuro).

Il regime sanzionatorio

La proposta di Regolamento prevede sanzioni sia predeterminate, sia commisurate al fatturato annuo globale della società nell’anno finanziario precedente.

In particolare, il regime sanzionatorio si suddivide in tre classi:

- 35 milioni di euro ovvero del 7% per le violazioni della normativa inerente le applicazioni IA vietate;

- 15 milioni di euro o 3% per violazioni degli obblighi della legge sull’IA;

- 7,5 milioni di euro ovvero 1,5% per la fornitura di informazioni errate.

Per le PMI e per le start-up, invece, sono previsti massimali più proporzionati, in caso di violazione delle disposizioni della legge sull’IA.

I prossimi passaggi e l’entrata in vigore

In queste settimane i tecnici europei porteranno avanti i lavori per finalizzare i dettagli della nuova Regolamentazione.

Se i termini previsti all’interno dell’atto provvisorio venissero confermati, l’AI Act diverrà applicabile due anni dopo la sua entrata in vigore, con alcune eccezioni per disposizioni specifiche:

– i divieti assoluti diverranno applicabili a sei mesi;

– i requisiti per i sistemi di IA ad alto rischio, i modelli di IA ad alto impatto, gli organismi di valutazione della conformità e il capitolo sulla governance diverranno applicabili a dodici mesi.

Lascia un Commento

Vuoi partecipare alla discussione?Fornisci il tuo contributo!